ETL vs ELT en 2025 : quelle approche pour votre Data Warehouse ?

Comprendre les différences entre ETL et ELT en 2025. Avantages, inconvénients, cas d'usage et guide pour choisir la bonne approche pour votre architecture data moderne.

En 2025, le paysage de l'intégration de données a significativement évolué, avec des changements majeurs dans l'adoption des approches ETL et ELT. Le choix optimal dépendra plus que jamais de l'infrastructure, des volumes de données, des exigences de flexibilité et de conformité.

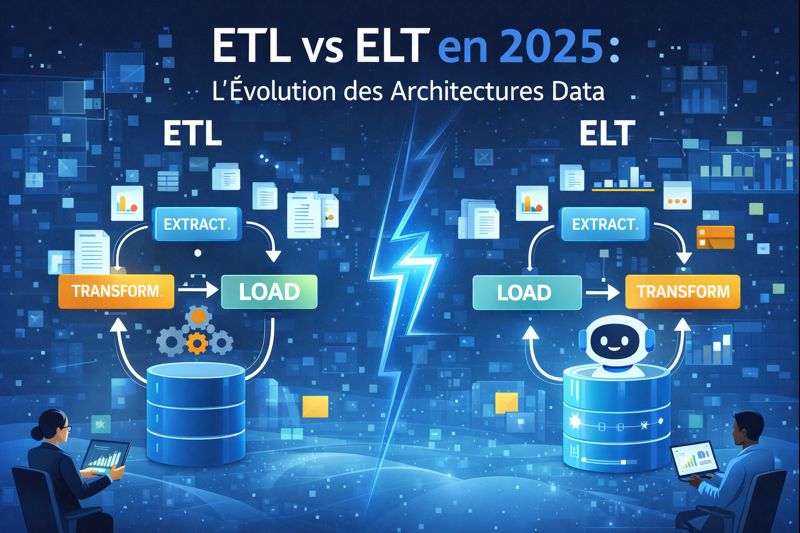

Comprendre l'ETL et l'ELT

Ces deux méthodes sont fondamentales pour l'intégration des données dans un Data Warehouse, mais leur distinction réside dans l'ordre des opérations :

- ETL (Extract, Transform, Load) : La transformation des données s'effectue AVANT leur chargement dans le Data Warehouse.

- ELT (Extract, Load, Transform) : La transformation des données s'effectue APRÈS leur chargement (des données brutes) dans le Data Warehouse.

Les Changements et Évolutions Majeurs en 2025

Plusieurs facteurs clés ont redéfini la pertinence de chaque approche :

1. ELT devient la Nouvelle Norme par Défaut

Le changement le plus significatif est que l'ELT s'est imposé comme la norme par défaut pour les architectures de données modernes en 2025.

Moteur du changement : L'essor des Data Warehouses cloud (comme Snowflake, Google BigQuery, Amazon Redshift, Azure Synapse, et particulièrement Microsoft Fabric) avec leur immense puissance de calcul massivement parallèle (MPP) a rendu l'ELT plus rapide, plus scalable et plus flexible.

Avantages clés de l'ELT :

- Rapidité : Chargement direct des données brutes, sans goulot d'étranglement intermédiaire.

- Scalabilité : Exploitation native de la puissance de calcul du DWH cloud.

- Flexibilité : Conservation des données brutes permettant des retraitements ou de nouvelles analyses à tout moment.

- Accès aux données brutes : Essentiel pour le Machine Learning et l'analytique avancée.

2. Le Rôle Spécifique et Négocié de l'ETL

Alors que l'ELT domine les nouvelles architectures, l'ETL ne disparaît pas. Son rôle est devenu plus ciblé et spécifique :

- Systèmes Legacy (On-Premise) : L'ETL reste pertinent pour l'intégration de données issues de Data Warehouses traditionnels ou de systèmes sur site qui ne disposent pas de la puissance de calcul des solutions cloud modernes.

- Données Très Sensibles et Conformité Stricte : Pour les secteurs comme la santé ou la finance, où des réglementations (ex: RGPD) imposent une transformation (masquage, anonymisation) avant le stockage final des données, l'ETL est toujours privilégié. Il assure que seules des données conformes et dé-identifiées entrent dans le DWH.

- Petits Volumes : Pour des volumes de données modestes, l'overhead et le coût de l'ELT cloud peuvent ne pas être justifiés.

3. L'Émergence Dominante de l'Approche Hybride

En 2025, la stratégie la plus courante pour les organisations est une combinaison intelligente des deux approches :

- ELT pour l'analytique moderne : Utilisation de l'ELT pour la majorité des données, les chargeant brutes dans un Data Lake (par exemple, dans OneLake de Microsoft Fabric) et effectuant les transformations avec des outils puissants comme dbt.

- ETL pour le legacy et la conformité : Réservation de l'ETL pour les systèmes existants ou pour les cas où la conformité exige une transformation préalable des données sensibles (PII).

Exemple avec Microsoft Fabric : Cette plateforme illustre parfaitement l'approche hybride, permettant une ingestion ELT via Data Factory, des transformations ELT avec des Notebooks Spark ou Dataflows Gen2 dans le Lakehouse, et des pipelines ETL spécifiques pour les données ultra-sensibles.

4. L'Évolution des Outils et de l'Écosystème

Le paysage des outils a suivi cette évolution :

- ELT : dbt (data build tool) est devenu le standard de facto pour les transformations au sein du Data Warehouse. Des plateformes comme Fivetran ou Airbyte facilitent l'ingestion de données brutes.

- Plateformes unifiées : Des solutions comme Microsoft Fabric sont conçues pour gérer nativement des workflows ELT et faciliter l'adoption d'architectures hybrides, intégrant ingestion, stockage et transformation dans un environnement cohérent.

- ETL : Des outils historiques comme Talend, Informatica PowerCenter, SSIS ou Apache NiFi continuent d'être utilisés, particulièrement pour les cas d'usage ETL spécifiques.

Comparatif Détaillé ETL vs ELT (Synthèse 2025)

| Critère | ETL (Rôle Spécifique) | ELT (Nouvelle Norme) |

| Vitesse chargement | Lent (transformation préalable) | Rapide (chargement direct des brutes) |

| Flexibilité | Faible (re-traitement coûteux) | Élevée (données brutes conservées) |

| Stockage requis | Optimisé (seulement les données finales) | Plus important (données brutes + transformées) |

| Coût infrastructure | Serveur ETL dédié (potentiellement) | Inclus dans la puissance du DWH cloud |

| Données brutes | Non conservées dans le DWH | Conservées (richesses pour futures analyses) |

| Conformité RGPD | Plus facile (transformation préalable) | À gérer finement dans le DWH (gestion des accès) |

| Machine Learning | Données souvent pré-agrégées | Accès aux données brutes (idéal pour ML) |

| Cas d'usage 2025 | Legacy, données ultra-sensibles | Cloud DWH, Big Data, Analytics avancées, Agilité |

Conclusion

En 2025, l'ELT est incontestablement le standard pour les architectures de données modernes, tirant pleinement parti de la puissance et de la flexibilité offertes par les Data Warehouses cloud. Cependant, l'ETL maintient une pertinence cruciale pour des cas d'usage spécifiques, notamment la gestion des systèmes hérités et la conformité stricte autour des données sensibles. La plupart des organisations adopteront une stratégie hybride pour optimiser leurs pipelines de données.